Сколько стоит LLM on-premise: разбор бюджета пилотного проекта

Железо, лицензии, команда, эксплуатация: из чего реально складывается бюджет корпоративного пилота нейросети в закрытом контуре в 2026 году

Заказчик спрашивает «сколько стоит внедрить нейросеть в нашем контуре» и ждёт одну цифру. Назвать её можно — но это будет цифра наугад. Десять юристов, которые ищут пункты в договорах, и колл-центр на тысячу человек с интеграцией в CRM — два разных проекта с разницей в порядок по бюджету. Прежде чем считать, нужно разобрать задачу.

Сама модель в большинстве случаев бесплатна: Llama, Qwen, GLM, DeepSeek и десятки других открытых моделей доступны под свободными лицензиями или близко к ним. Бюджет складывается из того, что вокруг модели: инфраструктура, подготовка данных, интеграция с корпоративными системами, требования по информационной безопасности, эксплуатация. Каждая из этих статей зависит от десятков параметров, и сумма получается широкой — от относительно скромного пилота на одной GPU до десятков миллионов рублей за защищённый контур, аттестованный по требованиям ФСТЭК.

Ниже — разбор статей бюджета пилотного проекта on-premise LLM: что в них реально входит, какие диапазоны цен встречаются на рынке РФ в 2026 году и какие сценарии пилота имеют смысл для разных задач. Без публичного прайса, но с практическими ориентирами.

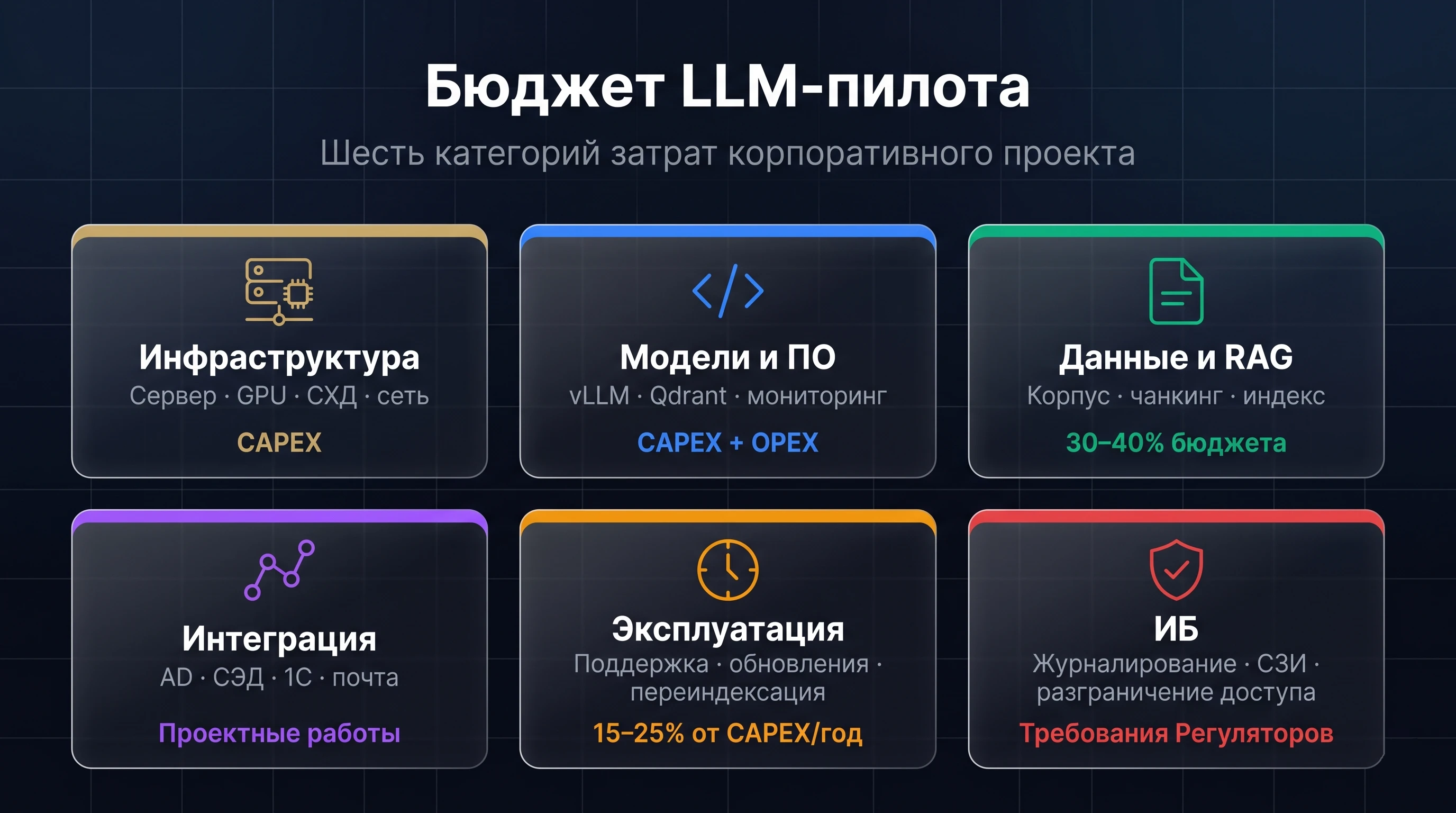

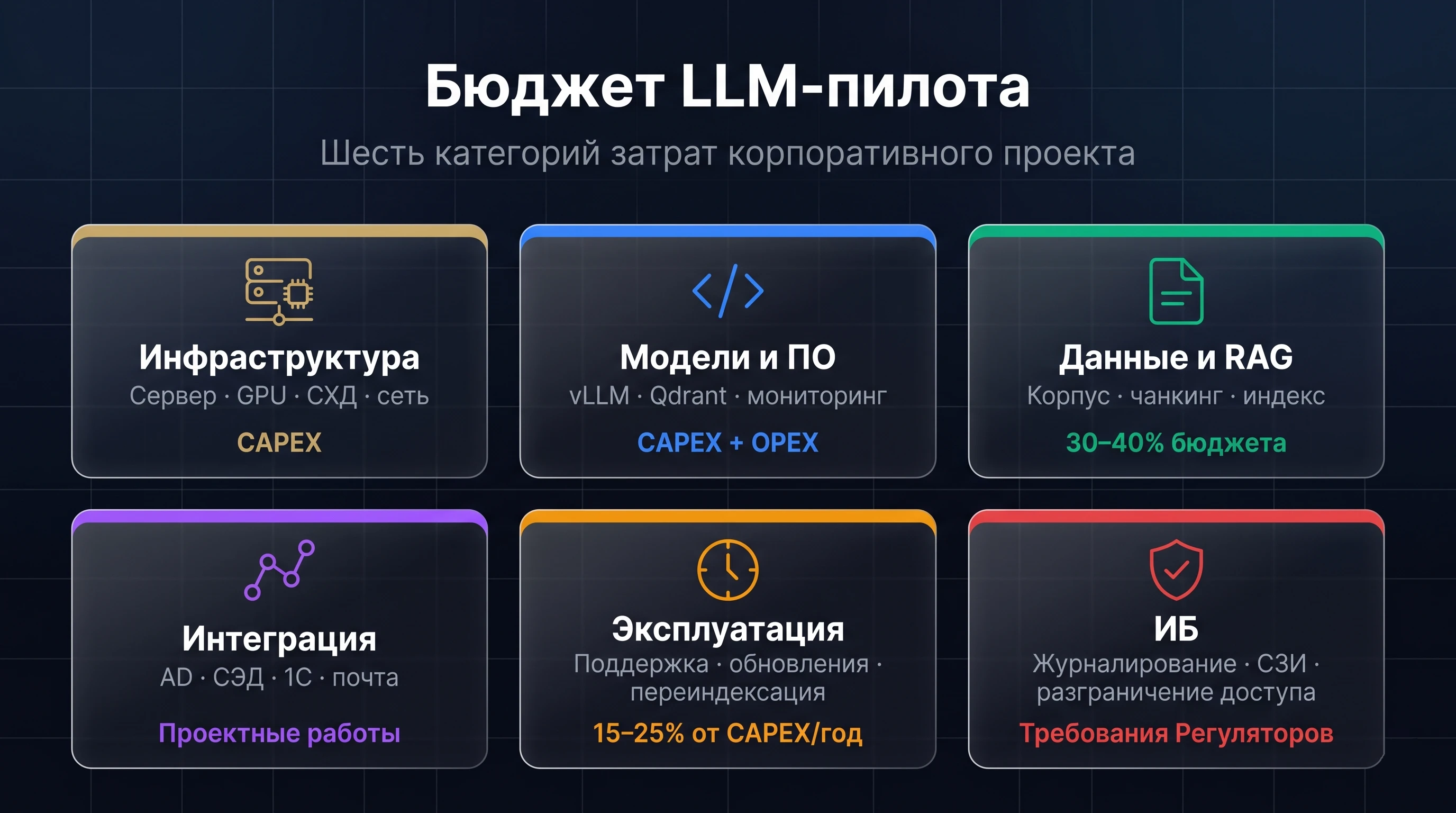

Что входит в бюджет пилота

Любой пилот корпоративной LLM раскладывается на шесть категорий затрат. Пропустить любую — значит получить неприятный сюрприз через три месяца после старта.

Сервер, GPU, СХД, сетевое оборудование, при необходимости — средства защиты информации и резервное копирование. Основная капитальная статья (CAPEX). Сюда же — электроэнергия и место в стойке.

Open-source-модели формально бесплатны, но обвязка — сервер инференса (vLLM, TGI, llama.cpp), векторная БД (Qdrant, Weaviate, pgvector), оркестрация, мониторинг — требует настройки.

Корпус документов нужно собрать, очистить, разметить, разрезать на чанки, проиндексировать и поддерживать индекс актуальным. На реальных пилотах это до 30–40% бюджета.

Подключение к Active Directory или Keycloak, к корпоративному файловому хранилищу, к 1С, Bitrix24, СЭД, почте. Каждое подключение — отдельная задача.

После запуска кто-то должен следить за качеством ответов, обновлять модель и базу знаний, чинить сбои, вести регламенты. Это OPEX, который часто забывают заложить.

Сегментация сети, журналирование обращений, разграничение доступа, при необходимости — сертифицированные средства. Для регулируемых отраслей выделяется в отдельную статью.

Пропорции между этими статьями сильно различаются. На скромном пилоте основной вес у железа и инженерных работ; в крупном корпоративном внедрении заметно растёт доля интеграции и эксплуатации. ИБ-расходы выделяются отдельно практически всегда, когда контур попадает под требования регулятора.

Железо: GPU-сервер для LLM 7B, 13B, 70B

Размер модели определяет объём памяти GPU и, как следствие, бюджет на железо. Практическое правило для FP16: модель занимает примерно 2 ГБ на каждый миллиард параметров. К этому добавляется память под контекст и KV-кэш — реально ещё 30–50%. Квантизация в INT8 или INT4 уменьшает требования в 2–4 раза, но даёт компромисс между скоростью и качеством, который надо тестировать на конкретных задачах.

Три тира GPU-конфигураций для корпоративных LLM-пилотов

LLM 7B — минимальный пилот

Модель в FP16 помещается на GPU с 24 ГБ памяти. Подходит для рабочей группы 5–20 человек и базового RAG по ограниченной базе документов. Стартовать можно на одной RTX A6000 48GB или паре потребительских карт класса RTX 4090 24GB, если бюджет совсем сжат и контур позволяет работать без сертифицированных решений. Розница в РФ на RTX A6000 — ориентировочно 500–730 тыс. ₽ за карту, цифру нужно уточнять у поставщика на дату закупки.

LLM 13B — устойчивый пилот

Стандартный рабочий вариант для большинства корпоративных задач: поиск по документам, ассистент юриста, помощь в подготовке КП. В FP16 модель просит около 30 ГБ памяти, в INT8 — 15–20 ГБ. Хороший вариант — одна A100 80GB или 2× RTX A6000. На рынке РФ A100 80GB сейчас стоит в коридоре 1,5–2,5 млн ₽ в зависимости от партии и поставщика. Полная сборка GPU-сервера с 1–2 A100, процессором, 256–512 ГБ ОЗУ и SSD-хранилищем — ориентировочно 3,5–5 млн ₽.

LLM 70B — производственный контур

Модели такого класса в FP16 требуют 140+ ГБ памяти, что означает минимум 2× A100 80GB или 4× RTX A6000 с распределением весов через NVLink. С квантизацией можно уложиться в одну H100 80GB, но H100 в РФ — товар дефицитный, ценник около 3 млн ₽ за карту, доступность нестабильна. Полноценная сборка под 70B — это бюджет от 8–12 млн ₽ за платформу с двумя A100 и от 15–25 млн ₽ за конфигурацию из 4 карт с резервированием.

Российский сервер из реестра Минпромторга

Если пилот идёт в государственной структуре или на объекте КИИ, требование «оборудование из реестра» становится почти обязательным. В реестре есть подходящие платформы Aquarius, Гравитон, Тринити, OpenYard, Delta Computers и других вендоров. Важный нюанс: «российский сервер» в реальности означает российскую платформу с импортными GPU — теми же NVIDIA A100, H100, L40S или RTX 6000 Ada. Полностью отечественных ускорителей, которые гарантированно тянут LLM 70B с поддержкой vLLM/TGI и стабильными драйверами, на массовом рынке пока нет.

Перед закупкой такого сервера обязательно проверять совместимость с конкретными фреймворками, наличие драйверов под выбранную ОС (Astra Linux, Альт, РЕД ОС), производительность на ваших задачах, сроки поставки и гарантию. Один из частых сюрпризов — несовместимость новой версии CUDA-драйвера с сертифицированной версией ОС.

Ценовые ориентиры по GPU — коридоры на май 2026 года. Курс рубля, доступность партий и санкционная логистика двигают цены ощутимо. Точную сумму нужно фиксировать в момент закупки, а не на этапе планирования.

ПО и лицензии: «бесплатный» open-source стоит денег

Здесь чаще всего возникает иллюзия экономии. Логика «возьмём Llama, она же открытая, и сэкономим миллионы» работает ровно до момента, когда модель надо запустить в продуктиве.

Open-source даёт три преимущества: данные не уходят за периметр, нет привязки к вендору, нет посекундной оплаты за токены. Но за это приходится платить инженерным временем — настройка инференс-сервера, профилирование под нагрузку, мониторинг, обновления, сопровождение. По стоимости одного токена open-source-модели заметно дешевле проприетарных API, однако эта экономия проявляется только при стабильной высокой нагрузке. На малых объёмах TCO open-source-стека может оказаться выше: фиксированные расходы на инженеров и инфраструктуру не масштабируются вниз вместе с трафиком.

Коммерческие модели в РФ — это GigaChat от Сбера, YandexGPT, доступ через корпоративные тарифы российских облаков (см. сравнение отечественных LLM). Они снимают с заказчика инфраструктурную головную боль, но возвращают вопрос комплаенса: можно ли отдавать конкретные данные стороннему API? Для регулируемых отраслей и КИИ ответ почти всегда отрицательный.

Лицензии популярных моделей

| Модель | Лицензия |

|---|---|

| Llama 3.x | Llama Community License |

| Qwen 2.5 / 3 | Apache 2.0 |

| DeepSeek V3 / R1 | MIT-подобная |

| GLM-4 | Условно открытая |

| Mistral / Mixtral | Apache 2.0 (часть моделей) |

| GigaChat | Проприетарная |

| YandexGPT | Проприетарная |

Meta признана экстремистской организацией и запрещена на территории РФ. При выборе Llama для корпоративного контура согласовывайте использование с юридической службой.

Архитектура типового стека

Минимальный набор компонентов корпоративного LLM-стека в закрытом контуре

В защищённом контуре к этому набору добавляются СЗИ, отдельный сегмент сети, сертифицированные средства аутентификации и журналирования. Реалистичный ориентир по программному стеку: open-source-обвязка (vLLM или TGI + Qdrant + LangChain/LlamaIndex + Prometheus/Grafana) сама по себе бесплатна, но настройка и интеграция в корпоративный контур — это десятки и сотни человеко-часов работы команды. Их и нужно закладывать в бюджет.

Работа команды

Для пилота уровня «всерьёз» нужны как минимум восемь ролей. В небольшой компании они часто совмещаются — три-четыре человека делают всё. В корпоративном пилоте состав почти всегда полный.

| Роль | Когда подключается |

|---|---|

| Архитектор решения | С первого дня |

| ML-инженер | После выбора модели |

| MLOps / DevOps | Параллельно с ML |

| Специалист по ИБ | С первого дня |

| Аналитик данных | На обследовании |

| Интегратор | После архитектуры |

| Тестировщик | Перед опытной эксплуатацией |

| Руководитель проекта | Сквозная роль |

Состав работ внутри пилота: предпроектное обследование, выбор модели и сравнение альтернатив, развёртывание инфраструктуры, настройка RAG и индексации, подключение источников документов, настройка ролей доступа, тестирование качества ответов, нагрузочное тестирование, подготовка регламентов эксплуатации, обучение пользователей и администраторов.

Ставки на российском рынке сильно разнятся: фриланс-инженер обходится дешевле, но без гарантий и сопровождения; интегратор берёт дороже, но даёт SLA и команду. Усреднённая стоимость инженерного часа в подрядной модели — 4–8 тыс. ₽, на руководящих и архитектурных ролях выше. Объём работ типового пилота — от 400–600 человеко-часов для минимального сценария до 2 000–3 500 для корпоративного.

Опытная эксплуатация: что считается в годовом OPEX

Это та статья, которую любят забывать на этапе согласования бюджета. После запуска пилот не работает сам по себе.

В состав годового OPEX входят: техническая поддержка инфраструктуры и модели, мониторинг работоспособности и качества ответов, обновление модели на новые версии, обновление и переиндексация базы знаний, устранение ошибок, доработка промптов под обнаруженные сценарии, сопровождение интеграций при изменениях в смежных системах, резервное копирование, поддержание контура информационной безопасности (включая защиту персональных данных), электроэнергия и охлаждение.

Точная пропорция зависит от инфраструктуры, состава команды и требований по SLA. Для типовой ИТ-инфраструктуры годовой OPEX обычно укладывается в 15–20% от CAPEX; для LLM-стека эта цифра шире — расходы на инженерное сопровождение, переиндексацию базы знаний и обновления моделей плохо предсказываются заранее. Для пилота с одним GPU-сервером и базовой поддержкой годовая эксплуатация ориентировочно 1,5–4 млн ₽; для контура с круглосуточной поддержкой и регулярным дообучением — в разы выше. Точную цифру всегда считают индивидуально.

Реалистичные диапазоны бюджета: три сценария

Заказчики AZONE-AI чаще всего попадают в один из трёх типовых сценариев. Они отличаются не только размером бюджета, но и логикой принятия решений: в минимальном пилоте экономят на всём, в корпоративном считают TCO на три года, в защищённом — первым делом смотрят на соответствие требованиям регулятора.

Три типовых сценария пилота: от рабочей группы до аттестованного контура

| Параметр | Минимальный пилот |

|---|---|

| Пользователи | 5–20 |

| Модель | 7B / 13B (квантизация) |

| Железо | 1× RTX A6000 или существующий сервер |

| Источники данных | 1–2, до нескольких тысяч документов |

| Интеграции | Базовые: AD, файлы |

| CAPEX (железо) | 0,7–1,5 млн ₽ |

| Проектные работы | 1–2 млн ₽ |

| Год эксплуатации (OPEX) | 0,5–1,5 млн ₽ |

Все цифры — ориентировочные коридоры, требующие уточнения под конкретный состав работ, оборудования, требований по ИБ и SLA. На итог влияют курс, доступность GPU на момент закупки, состав команды, наличие у заказчика собственной инфраструктуры, требования регулятора и десятки других факторов. Подробнее о подготовке контура — в материале о промышленном развёртывании on-premise LLM.

ROI: как считать эффект

Условный кейс — без раскрытия реальных клиентов. В компании 30 сотрудников регулярно ищут информацию в договорах, регламентах, ТЗ, КП, инструкциях и переписке. До внедрения средний поиск ответа занимает 30–60 минут — листать СЭД, спрашивать коллег, поднимать архив. После пилота с RAG по корпоративным документам тот же поиск занимает 3–7 минут.

Если каждый сотрудник делает 3–5 таких поисков в день и средняя экономия — 30 минут на запрос, это 1,5–2,5 часа в день на человека. На 30 сотрудниках — 45–75 часов в день, около 900–1 500 часов в месяц. При стоимости рабочего часа специалиста с накладными в 1 500–2 500 ₽ месячная экономия рабочего времени оценивается в 1,3–3,8 млн ₽.

К этому добавляются эффекты, которые сложнее посчитать в деньгах: меньше нагрузки на экспертов, к которым перестают идти с типовыми вопросами; быстрее подготовка КП и ответов на запросы; меньше ошибок при работе со сложными документами; быстрее ввод новых сотрудников в курс дела.

Эти цифры — методика, а не обещание. Реальный ROI зависит от качества внедрения, дисциплины пользователей, актуальности базы знаний и десятка организационных факторов. Гарантировать конкретный срок окупаемости заранее некорректно. Корректно — показать, как считать и за счёт каких эффектов окупаемость складывается.

Где обычно ошибаются

Самые дорогие ошибки в LLM-пилотах не относятся к технике. Они управленческие.

На закупке

GPU-платформа за десятки миллионов рублей, которая через полгода загружена на 10–15%: сервер выбрали под перспективную задачу, которая так и не вышла за стадию обсуждения.

Бывает, что задача решается без LLM вовсе — обычным полнотекстовым поиском или правильно настроенной СЭД. Бывает, что требуется другая архитектура: классификатор плюс поиск, без генеративной модели.

Лицензия — да; инженеры, инфраструктура и эксплуатация — нет. По стоимости владения open-source-стек на низких нагрузках может оказаться дороже коммерческого API.

В архитектуре

13B на нормальном RAG чаще даёт лучший ответ, чем 70B без него: модель может быть мощнее, но если она не знает корпоративный контекст, разница в параметрах не помогает.

Переделывать всегда дороже, чем сразу спроектировать. Особенно если контур попадает под требования по защите персональных данных или объектов КИИ.

Без них непонятно, работает ли пилот: «вроде отвечает» — это не результат. Минимум — тестовый набор из 50–100 реальных вопросов с эталонными документами.

В управлении

Через полгода без сопровождения база знаний устаревает, ответы деградируют, пользователи теряют доверие. Восстанавливать доверие сложнее, чем удерживать.

Пилот — управляемый эксперимент с понятной гипотезой и метриками. Промышленная система строится после пилота, на основе его выводов.

Выводы

Стоимость LLM on-premise — это бюджет проекта целиком: инфраструктура, данные, интеграция, безопасность, сопровождение. Каждая статья считается отдельно, и каждая зависит от десятков параметров, которые становятся ясны только после предпроектного обследования.

Разумный пилот не требует «миллиардного» бюджета и кластера на 8 H100. Минимальный сценарий укладывается в несколько миллионов рублей и даёт ответ на главный вопрос: имеет ли смысл двигаться дальше. Корпоративный пилот стоит больше, но и эффект масштабируется. Защищённый контур для регулируемых отраслей — отдельная история со своими требованиями и бюджетом.

Главное — не покупать железо до того, как стало понятно, что именно вы решаете. Пилот должен ответить на вопрос «работает ли это в нашей конкретной обстановке», а не закрыть всю задачу автоматизации сразу.

Если нужен ориентир по бюджету под конкретную задачу, AZONE-AI может провести экспресс-оценку: разобрать сценарий, прикинуть требования к инфраструктуре и собрать диапазон CAPEX/OPEX — оставьте заявку на консультацию.

Частые вопросы

Сколько GPU нужно для запуска LLM 70B on-premise?

В FP16 — минимум 2× A100 80GB или 4× RTX A6000 с распределением весов через NVLink. С квантизацией в INT8/INT4 модель помещается на одну H100 80GB, но это компромисс по качеству, который надо тестировать на конкретных задачах.

Можно ли запустить корпоративную LLM без сервера с A100?

Да. Для рабочей группы 5–20 человек на модели 7B достаточно одной RTX A6000 48GB или пары RTX 4090. Это рабочий вариант для пилота, но не для боевого контура с десятками одновременных сессий и требованиями по отказоустойчивости.

Что включается в эксплуатационные расходы on-premise LLM?

Техническая поддержка инфраструктуры, мониторинг качества ответов, обновление моделей и базы знаний, доработка промптов, сопровождение интеграций, резервное копирование, поддержание контура ИБ, электроэнергия и охлаждение. Ориентировочно 15–25% от CAPEX в год для типового пилота.

Чем пилот отличается от промышленного внедрения LLM?

Пилот — управляемый эксперимент на ограниченной задаче с понятными метриками и фиксированным сроком (обычно 2–4 месяца). Его задача — проверить гипотезу, а не закрыть всю автоматизацию. Промышленная система строится после пилота, с учётом его результатов и накопленных данных.

Подойдёт ли GigaChat или YandexGPT вместо on-premise?

Для нерегулируемых задач — часто да: проще, дешевле в старте, не нужно содержать команду эксплуатации. Для работы с персональными данными, коммерческой тайной, объектами КИИ или другой чувствительной информацией ответ почти всегда отрицательный — данные нельзя отдавать стороннему API.

Сколько занимает пилотный проект LLM по времени?

Минимальный пилот — 6–10 недель от старта обследования до первых ответов в тестовом режиме. Корпоративный — 3–5 месяцев. Защищённый контур с сертифицированной инфраструктурой — от 6 месяцев и больше; основная задержка обычно на закупке и согласованиях, а не на технической части.

Актуальность материала

- Материал подготовлен по состоянию на май 2026 года.

- Ценовые ориентиры по GPU и серверным платформам — коридоры рыночной розницы в РФ. Курс рубля, доступность партий и санкционная логистика двигают цены ощутимо: уточняйте у поставщиков на дату закупки.

- Лицензионные условия моделей могут меняться. Перед коммерческим использованием проверяйте актуальную лицензию у разработчика и согласовывайте с юридической службой.

- Расчёт ROI — иллюстративная методика. Реальные результаты зависят от качества данных, дисциплины пользователей и организационных факторов.

Получите ориентир по бюджету пилота

За 1–2 недели разберём задачу, прикинем требования к инфраструктуре и соберём диапазон CAPEX/OPEX под ваш сценарий. Лицензии ФСТЭК, ФСБ и МО РФ. Опыт с 2003 года.