Сравнение отечественных LLM: YandexGPT, GigaChat и альтернативы

Объективное сравнение российских языковых моделей для корпоративного использования — критерии, цены, on‑premise, RAG

Ещё два года назад вопрос «какую языковую модель выбрать» для большинства российских компаний не стоял — ChatGPT казался единственным разумным вариантом. Сегодня ситуация принципиально иная.

Санкционное давление, требования 152-ФЗ о локализации персональных данных, растущая настороженность регуляторов к трансграничной передаче информации — всё это превратило выбор LLM из технической задачи в стратегическое решение. Для компаний, работающих с государственными заказчиками, обрабатывающих персональные данные или оперирующих коммерческой тайной, использование зарубежных облачных моделей стало если не невозможным, то юридически рискованным.

Параллельно российские вендоры за последние полтора года сделали заметный рывок. YandexGPT вышел на версию 5.1 Pro, Сбер представил GigaChat Ultra с открытым кодом, а на рынке появились нишевые решения от MTS AI, Т-Банка и облачных провайдеров. Рынок перестал быть экспериментальным — пришло время прагматичного выбора.

Эта статья — попытка дать ИТ-руководителю и бизнес-заказчику объективную картину: что реально умеют отечественные LLM, где их сильные и слабые стороны, и как выбирать модель не по маркетинговым обещаниям, а под конкретный корпоративный сценарий.

Почему нельзя выбирать LLM «по громкости бренда»

Демонстрация на конференции и работа в продакшене — два разных мира. Вендор показывает идеально подобранные промпты и заранее отрепетированные сценарии. В реальной корпоративной среде модель сталкивается с зашумлёнными данными, нечёткими инструкциями и пользователями, которые формулируют запросы далеко не так, как хотелось бы промпт-инженеру.

Когда вендор заявляет «превосходит GPT-4.1 в 56% случаев» — это результат на конкретной выборке. На вашем корпусе договоров результаты могут оказаться совершенно другими.

Важно не абстрактное «понимание», а конкретные навыки: суммаризация юридического текста, извлечение реквизитов из договора, классификация обращений. Здесь разрыв между моделями существенный.

Модель через API может быть недоступна on-premise. А open-source версия того же вендора может заметно уступать проприетарной по качеству.

Вывод. Единственный надёжный способ выбора — пилотное тестирование на ваших данных и ваших задачах. Но чтобы сузить список кандидатов, нужно понимать архитектуру предложений на рынке.

Кого сравниваем: российские LLM в 2026 году

Семейство моделей Яндекса через Yandex Cloud AI Studio. Флагман — YandexGPT 5.1 Pro. Плюс Alice AI и YandexGPT 5 Lite в открытом доступе.

Модели Сбера 2-го поколения: Lite, Pro, Max. Флагман — GigaChat Ultra с открытым кодом. GigaChat 3 Ultra — MoE на 702 млрд параметров.

Облачная B2B-платформа с агрегатором моделей. Интеграция с Audiogram для речевой аналитики. Инфраструктура ЦОД МТС.

DeepSeek, Qwen, Llama, ruGPT, T-lite, GigaChat Ultra — на собственной инфраструктуре через vLLM, LangChain, векторные БД.

8 критериев объективного сравнения LLM для бизнеса

YandexGPT 5.1 Pro

Сильные стороны

YandexGPT 5.1 Pro в начале 2026-го — одна из наиболее сильных отечественных моделей для задач, связанных с текстом. Версия 5.1 Pro заметно снизила частоту галлюцинаций и лучше следует системным промптам. Модель глубоко интегрирована в экосистему Yandex Cloud: AI Studio предоставляет удобную среду, OpenAI-совместимый API (с марта 2026), а эмбеддинг-модели позволяют строить RAG-пайплайны без сторонних компонентов.

Для корпоративных клиентов важна связка с Яндекс 360 для бизнеса: интеграция с почтой, документами и облачным хранилищем. В линейке есть YandexGPT Lite — быстрая и дешёвая, для массовых операций. YandexGPT 5 Lite выложена в открытый доступ на HuggingFace.

Слабые стороны

По независимым тестам, модель иногда отказывается отвечать, ссылаясь на «отсутствие актуальных данных» — даже по устоявшимся темам. Может обрывать ответы при работе с длинными инструкциями. Полноценного on-premise для Pro-версии нет — доступ только через Yandex Cloud. Open-source Lite существенно уступает Pro. Стоимость Pro через API выше, чем у GigaChat.

Где подходит. Компании в экосистеме Yandex Cloud. Суммаризация русскоязычных текстов. RAG с эмбеддингами Яндекса. Быстрые пилоты через AI Studio.

Ограничения. Не подходит для полностью изолированного контура (Pro недоступна on-premise). Для задач с кодом и сложным рассуждением уступает. Привязка к Yandex Cloud.

GigaChat 2 Max и Ultra

Сильные стороны

GigaChat в 2026 году — зрелая платформа с чётким разделением моделей. Линейка второго поколения (Lite, Pro, Max) с контекстом 128 000 токенов покрывает весь спектр задач. Мультимодальность «из коробки» — текст, изображения (Кандинский), аудио, видео, веб-поиск — делает GigaChat единственной российской моделью с таким набором.

Ключевое преимущество: Сбер опубликовал код и веса GigaChat Ultra для развёртывания в закрытом контуре. Данные не используются для дообучения по умолчанию. Ценовая политика агрессивная: GigaChat 2 Lite — от 190–200 ₽ за 1 млн токенов. Миллион бесплатных токенов в год для API-пользователей.

Слабые стороны

Авторизация через API нестандартна — временный токен, собственный формат ответов. Документация уступает Yandex Cloud. В задачах программирования значительно слабее западных моделей. В сложных аналитических задачах Pro может уступать YandexGPT 5.1 Pro. Склонность к галлюцинациям.

Где подходит. Экосистема Сбера (SberID, MAX). Мультимодальные задачи. Массовые операции с текстом при ограниченном бюджете (Lite). Закрытый контур — Ultra с открытыми весами.

Ограничения. API требует SberID и российский номер. Нестандартный формат увеличивает стоимость интеграции. Для кода и аналитики — рассматривайте альтернативы.

MTS AI и MWS GPT

МТС запустила MWS GPT — облачную B2B-платформу, объединяющую собственные и open-source модели. Ключевая ценность — агрегатор, позволяющий одновременно работать с разными LLM, дообучать их и использовать function calling. Интеграция с Audiogram даёт готовый пайплайн для транскрипции звонков и видеоконференций с последующей суммаризацией.

Собственные LLM пока менее зрелые, чем YandexGPT и GigaChat — платформа больше ориентирована на работу с open-source моделями. Ценообразование менее публичное.

Где подходит. Агрегатор моделей с единой точкой входа. Речевая аналитика: контакт-центры, совещания, переговоры. Крупный бизнес на инфраструктуре МТС.

Open-source модели в приватном контуре

Для организаций с жёсткими требованиями ИБ — банков, оборонных предприятий, госструктур — развёртывание open-source LLM на собственной инфраструктуре остаётся единственным полностью контролируемым вариантом. Экосистема зрелая: vLLM для инференса, LangChain/LlamaIndex для оркестрации, Qdrant/Milvus для RAG.

Наиболее практичные варианты в 2026: Qwen3 (14B–235B, сильная мультиязычность), DeepSeek V3 (отличная цена/качество, аналитика), Llama 3.1 (8B–70B, хорошая база для дообучения). Из российских — ruGPT, T-lite, GigaChat Ultra, YandexGPT 5 Lite.

По данным аналитиков, open-source модели в среднем в 40 раз дешевле проприетарных на уровне стоимости токена — но эта экономия компенсируется затратами на инфраструктуру и дефицитные кадры.

Требования к ресурсам. Для модели уровня 70B параметров — минимум 2–4 карты A100/H100. Необходима команда с экспертизой в MLOps. Без дообучения качество «из коробки» может не соответствовать ожиданиям.

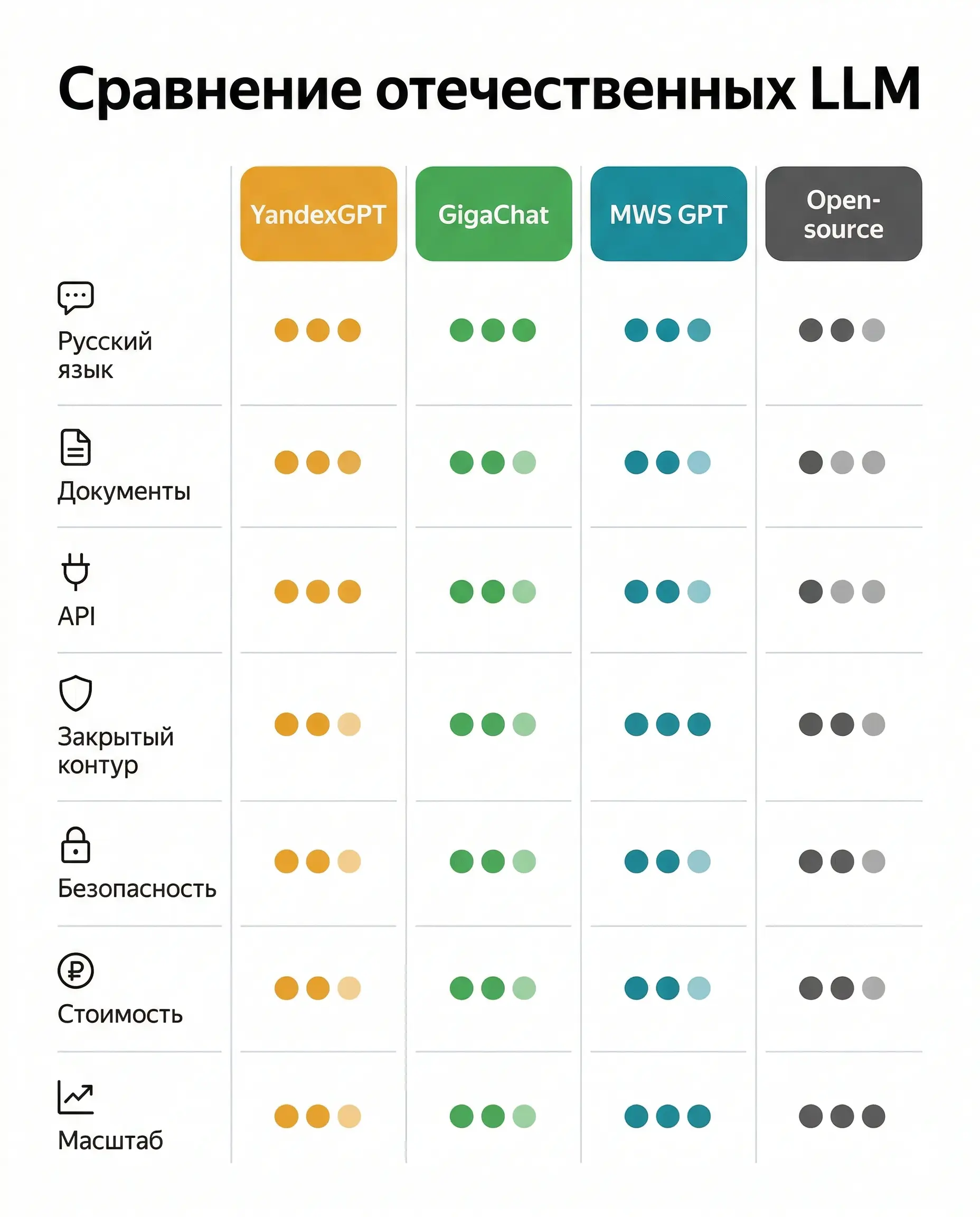

Сводная сравнительная таблица

| Критерий | YandexGPT | GigaChat |

|---|---|---|

| Русский язык | Высокий | Высокий |

| Контекстное окно | До 32K (Pro) | 128K токенов |

| Мультимодальность | Текст, эмбеддинги | Текст, изображения, аудио, видео |

| API-совместимость | OpenAI-совместимый | Собственный формат |

| On-premise | Только Lite (open-source) | Ultra (открытые веса) |

| Данные в РФ | Да (Yandex Cloud) | Да (инфраструктура Сбера) |

| Стоимость API (1 млн токенов) | ~800 ₽ (Pro 5.1) | ~650 ₽ (Max) |

| Дообучение | Через Yandex Cloud | Через SberDevices |

Цены ориентировочные по состоянию на начало 2026 года, могут отличаться в зависимости от тарифного плана и объёма.

Сравнение отечественных LLM по 7 ключевым критериям для корпоративного использования

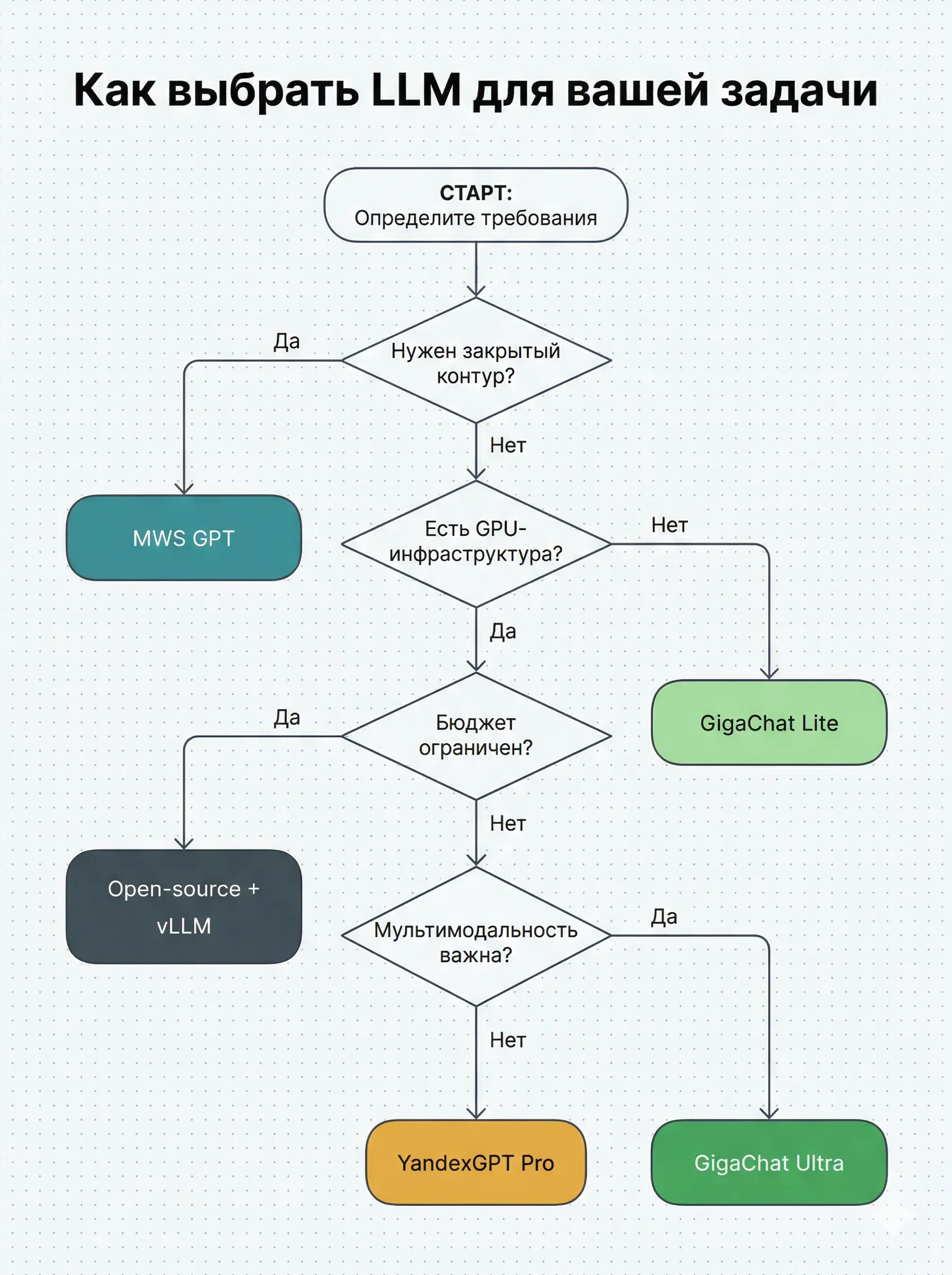

Как выбрать LLM под корпоративный сценарий

Дерево решений: от задачи к оптимальной модели

AI-ассистент для сотрудников

Чат-бот по HR, ИТ, черновики документов. Ключевое — скорость и стоимость на потоке.

GigaChat 2 Lite / YandexGPT Lite

Семантический поиск (RAG)

Поиск по базе знаний, регламентам. Критичны: эмбеддинги, контекстное окно, точность.

YandexGPT + эмбеддинги / GigaChat Max / Qwen3 on-prem

Обработка обращений и писем

Классификация, маршрутизация, черновики ответов. Задача массовая, чувствительна к цене.

GigaChat 2 Lite / YandexGPT Lite

Аналитика и суммаризация

Договоры, протоколы, отчёты. Нужна «тяжёлая» модель с хорошим следованием инструкциям.

YandexGPT 5.1 Pro / GigaChat 2 Max

Закрытый контур

Полная изоляция. Открытые веса, собственная GPU-инфраструктура.

GigaChat Ultra / Qwen3 / DeepSeek V3

Повышенные требования ИБ

Гостайна, конфиденциальные ПДн. Только on-premise с аттестацией, без телеметрии.

Open-source (Qwen / Llama) на сертифицированном ПАК

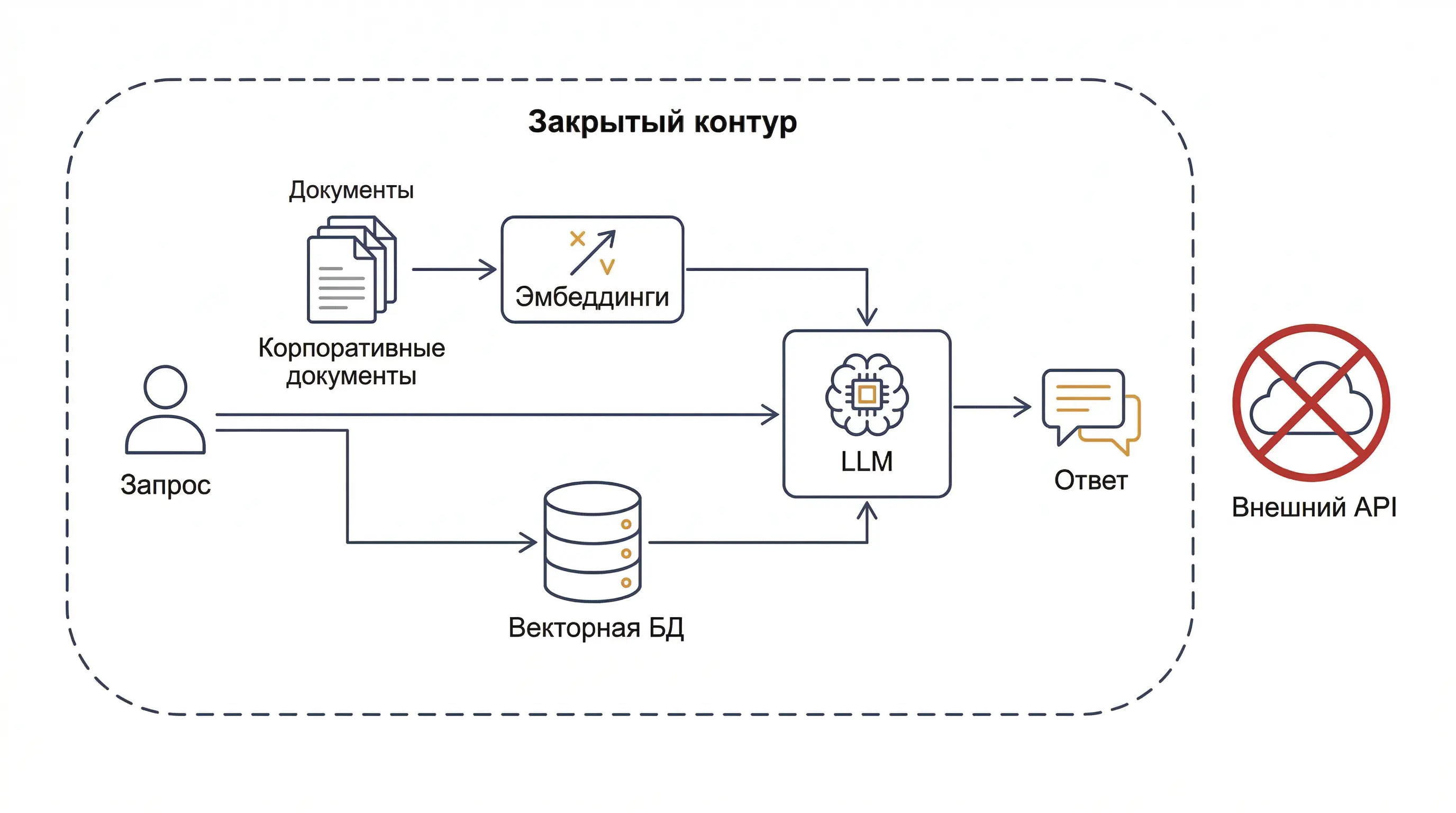

Архитектура RAG в закрытом контуре

Для семантического поиска по корпоративным документам критичны три компонента: качество эмбеддингов, способность модели работать с извлечёнными фрагментами и размер контекстного окна. Yandex Cloud предлагает готовые эмбеддинг-модели, GigaChat 2 Max с контекстом 128K позволяет передавать больше контекста. Для закрытого контура — Qwen3 или DeepSeek с Qdrant и LangChain.

RAG в закрытом контуре: корпоративные документы → эмбеддинги → векторная БД → LLM → ответ

Какую LLM выбрать: практические выводы

Главный вывод. «Лучшей модели вообще» не существует. Есть модель, оптимальная для вашей задачи, вашего бюджета и ваших ограничений по безопасности.

Лучшее соотношение цены и качества на русском

Сильнее в следовании инструкциям и точности

Открытые веса, полный контроль

Единственная отечественная платформа с такой широтой

Готовая интеграция транскрипции и суммаризации

Дороже в запуске, гибче в долгосрочной перспективе

Заключение

Рынок отечественных LLM перешёл от стадии «интересных экспериментов» к стадии практического выбора. YandexGPT и GigaChat конкурируют по ценам, наращивают качество и расширяют корпоративные инструменты. Open-source экосистема предоставляет реальную альтернативу для закрытого контура. Нишевые игроки закрывают специфические сценарии.

Но выбор модели — это лишь часть уравнения. Успех определяется архитектурой решения: как построен RAG-пайплайн, как организован доступ к данным, как настроена фильтрация и валидация ответов, как обеспечивается безопасность. Модель — это двигатель. Но без шасси, трансмиссии и системы управления автомобиль никуда не поедет.

Определите конкретный бизнес-процесс, где LLM даст измеримый эффект. Проведите пилот на 2–3 моделях с реальными данными. Оцените не только качество ответов, но и стоимость владения, требования к безопасности и готовность инфраструктуры. И только потом масштабируйте.

AZONE AI помогает компаниям выбрать, развернуть и интегрировать ИИ-решения с учётом требований информационной безопасности. Если вашей организации нужна экспертная оценка сценариев внедрения LLM — оставьте заявку на пилотный проект.

Актуальность материала

- Материал подготовлен по состоянию на апрель 2026 года.

- Рынок LLM меняется быстро: версии моделей, цены и доступные функции могут измениться в течение нескольких месяцев.

- Перед принятием решения рекомендуем проводить пилотное тестирование на ваших данных и задачах.

Не знаете, какую LLM выбрать?

За 4–8 недель мы протестируем 2–3 модели на ваших данных и развернём оптимальное решение на вашей инфраструктуре.

Заказать пилот